Deepfake Teknolojisinin Kötüye Kullanımı

Deepfake teknolojisi, gerçek kişilerin görüntü ve seslerini kullanarak sahte videolar oluşturmayı mümkün kılıyor. Bu teknoloji şimdi, çeşitli sağlık ürünlerini tanıtmak için ünlülerin ve sağlık uzmanlarının görüntülerini kullanarak kötüye kullanılıyor. Örneğin, ünlü bir doktorun görüntüsü kullanılarak, gerçekte hiç onaylamadığı bir ürünü tanıtır gibi gösteriliyor.

Tüketiciler İçin Artan Riskler

Bu sahte videolar, tüketicileri yanıltarak potansiyel olarak zararlı veya etkisiz ürünleri satın almaya yönlendirebiliyor. Özellikle ciddi sağlık sorunları yaşayan kişiler için bu durum, gerekli tıbbi tedaviyi geciktirme veya tamamen reddetme riski taşıyor.

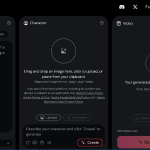

Sosyal Medya Platformlarının Mücadelesi

Sosyal medya devleri, bu tür içeriklerle mücadele etmek için çeşitli önlemler alıyor. Örneğin, yapay zeka destekli içerik tespit sistemleri kullanılıyor ve şüpheli içerikler için uyarı etiketleri ekleniyor. Ancak, deepfake teknolojisinin hızlı gelişimi, bu mücadeleyi zorlaştırıyor.

Yasal Düzenlemeler ve Etik Tartışmalar

Bu gelişmeler, deepfake teknolojisinin kullanımı konusunda yeni yasal düzenlemelerin gerekliliğini gündeme getiriyor. Aynı zamanda, yapay zeka teknolojilerinin etik kullanımı üzerine tartışmaları da alevlendiriyor.

Tüketiciler İçin Öneriler

Uzmanlar, tüketicilere sosyal medyada gördükleri sağlık içeriklerine karşı dikkatli olmalarını öneriyor. Herhangi bir ürün veya tedavi yöntemi hakkında karar vermeden önce güvenilir kaynaklardan bilgi alınması ve sağlık profesyonellerine danışılması öneriliyor.

Geleceğe Bakış

Deepfake teknolojisinin gelişmeye devam edeceği düşünüldüğünde, bu sorunun yakın gelecekte daha da büyüyebileceği öngörülüyor. Bu nedenle, teknoloji şirketleri, yasa koyucular ve sağlık otoritelerinin işbirliği içinde çalışarak etkili çözümler üretmesi gerekiyor.

Sonuç olarak, yapay zeka destekli deepfake’lerin sağlık alanında kötüye kullanımı, dijital çağın yeni bir zorluğu olarak karşımıza çıkıyor. Bu durumla mücadele etmek için toplumun tüm kesimlerinin bilinçli ve dikkatli olması gerekiyor.